Desafios na análise de risco em seguros

A análise de risco em seguros enfrenta um cenário complexo: os analistas precisam examinar múltiplas fontes de dados, avaliar riscos e tomar decisões que atendam a requisitos regulatórios cada vez mais rigorosos. Esse processo se torna ainda mais desafiador quando a organização enfrenta três problemas críticos.

Primeiro, os dados estão fragmentados. Informações de clientes residem em sistemas de Gestão de Relacionamento com Clientes (Sistemas de CRM), repositórios de documentos e bases de dados transacionais, criando silos que dificultam uma análise integrada e confiável.

Segundo, há pressão regulatória. As autoridades exigem decisões que sejam explicáveis e auditáveis — propriedades que abordagens tradicionais baseadas em modelos de “caixa preta” não conseguem fornecer adequadamente.

Terceiro, há necessidade de escala. As organizações precisam manter regras de análise consistentes e automatizadas em todo o portfólio, com capacidade de identificar proativamente sinais de fraude e comportamentos suspeitos.

Uma solução integrada com inteligência artificial

A AWS apresenta uma arquitetura que combina diferentes componentes para resolver esses desafios. O pilar técnico dessa solução é o Amazon Nova 2 Lite, um modelo de linguagem que fornece raciocínio transparente e explicável para cada decisão tomada.

Como funciona a arquitetura

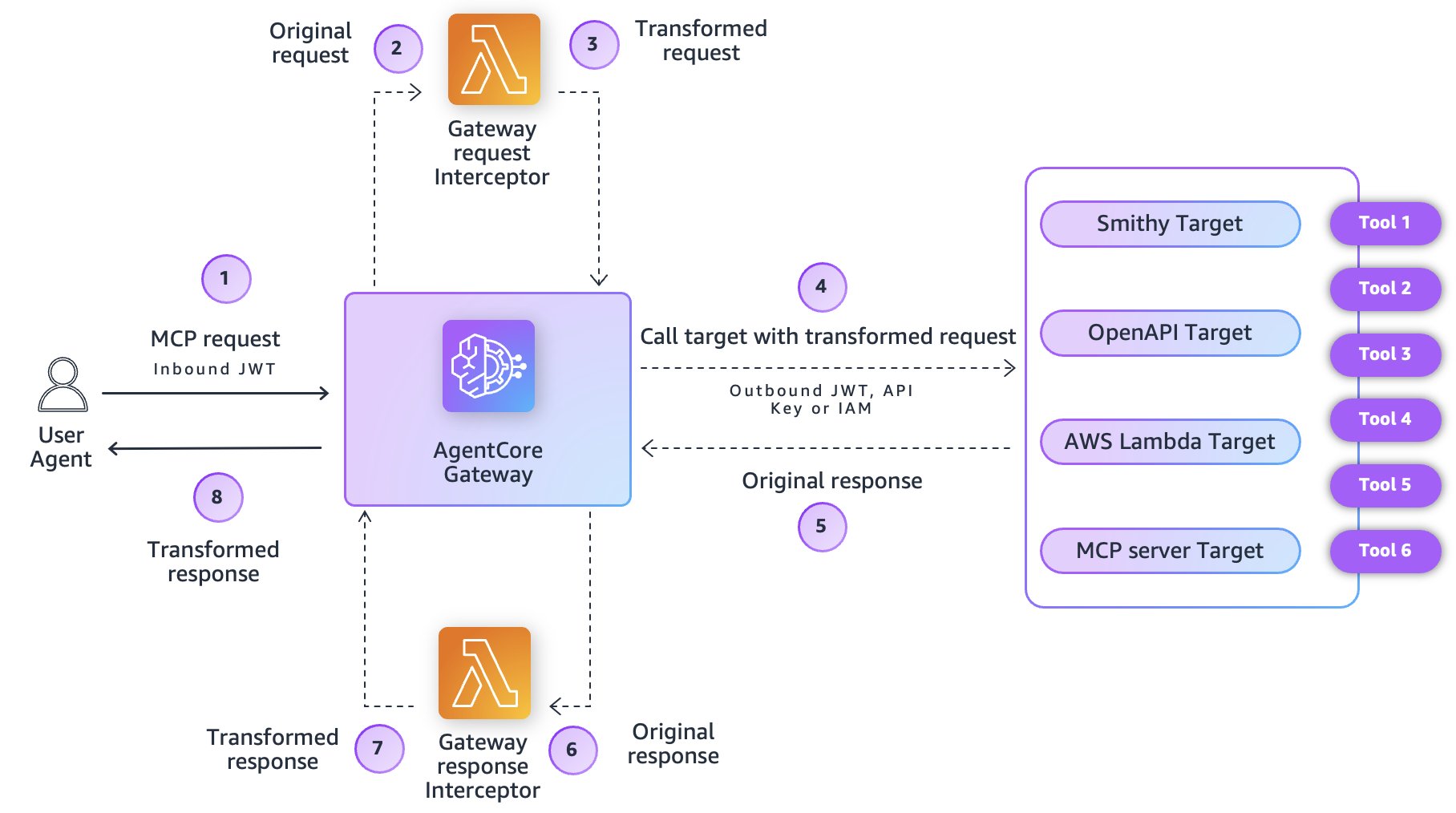

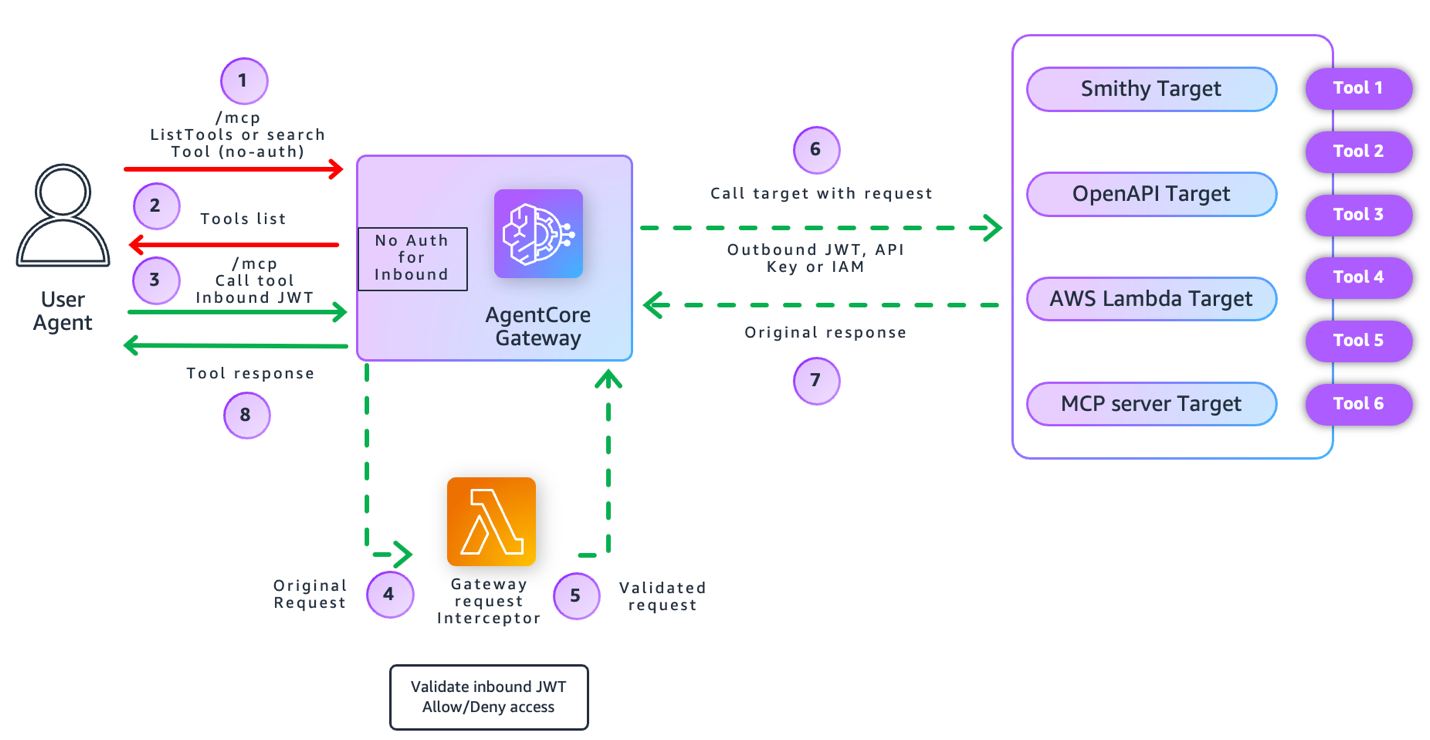

A solução utiliza o Protocolo de Contexto de Modelo (MCP) para criar ferramentas especializadas em três tarefas: detecção de fraude em seguros, avaliação de risco de um solicitante e tomada de decisão sobre cobertura. Quando uma ferramenta é acionada a partir de uma consulta, ela acessa dados de fontes específicas — repositórios de documentos como Amazon Simple Storage Service (S3) e bases de dados como Amazon DynamoDB — e invoca o Amazon Nova 2 Lite para análise e geração de recomendações.

Depois de recuperar as instruções de sistema e o contexto necessário, o modelo retorna uma resposta estruturada conforme esperado pela ferramenta. O servidor MCP é hospedado no Amazon Bedrock AgentCore Runtime com autorização de entrada via OAuth 2.0. Já o cliente MCP do Amazon Quick Suite é configurado com autenticação de serviço para permitir conexões de entrada ao servidor MCP.

A interação do usuário ocorre de forma natural: o agente de conversa processa consultas em linguagem natural, invoca as ferramentas MCP necessárias e mantém diálogos interativos com múltiplas trocas de mensagens.

Fluxo de operação

O fluxo começa quando um usuário autenticado do Quick Suite acessa o agente de conversa do Quick Suite e submete uma pergunta através da interface do assistente. Um exemplo seria: “Avalie o risco para o solicitante APP-0900”.

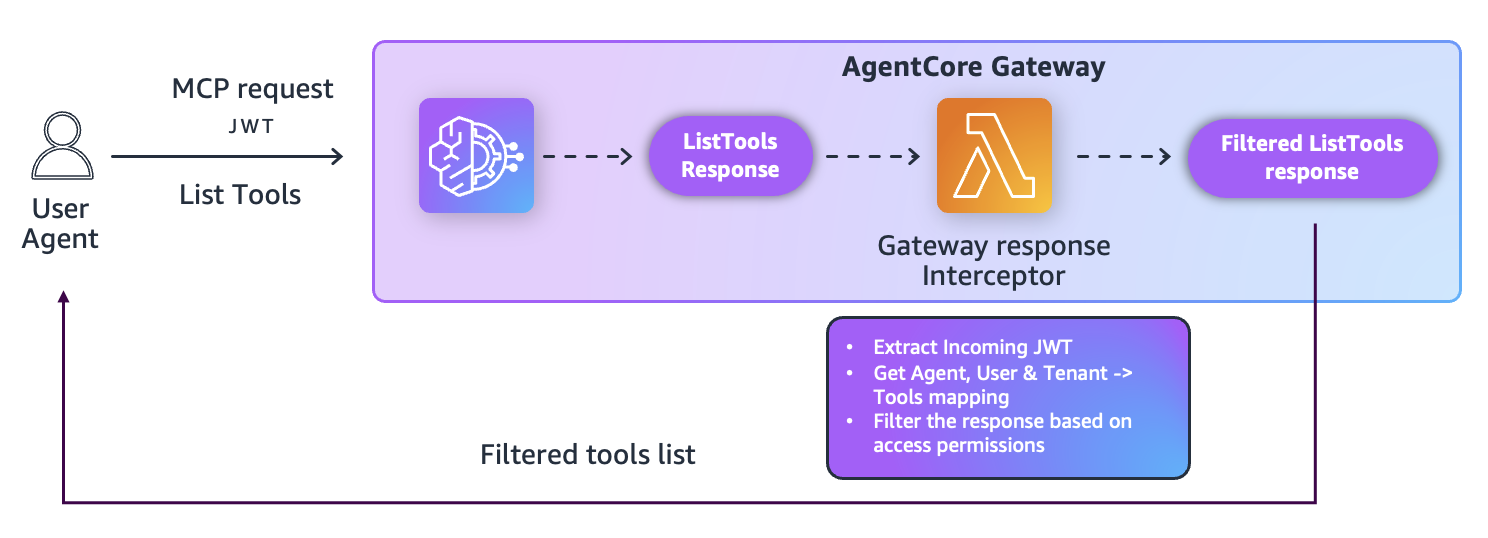

O agente de conversa está integrado com as Integrações de Ações MCP do Amazon Quick Suite para invocar ações em um servidor MCP implantado no AgentCore Runtime. O agente analisa a pergunta para entender a intenção, identifica entidades-chave como identificadores de solicitantes e números de sinistros, e decide quais ferramentas MCP devem ser acionadas.

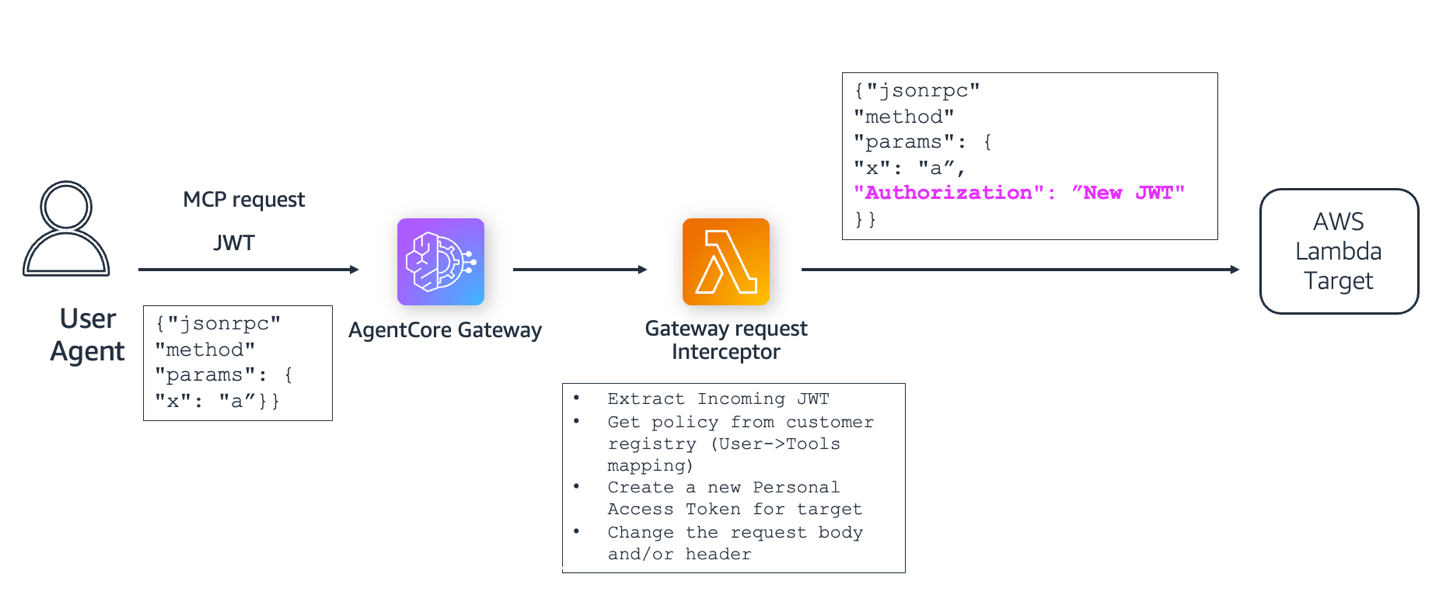

O cliente MCP do Quick Suite solicita um token de acesso do Amazon Cognito usando credenciais de cliente OAuth. O Cognito valida as credenciais e emite um token de curta duração. O Quick Suite inclui esse token na requisição ao AgentCore Runtime, que valida o token contra o Cognito.

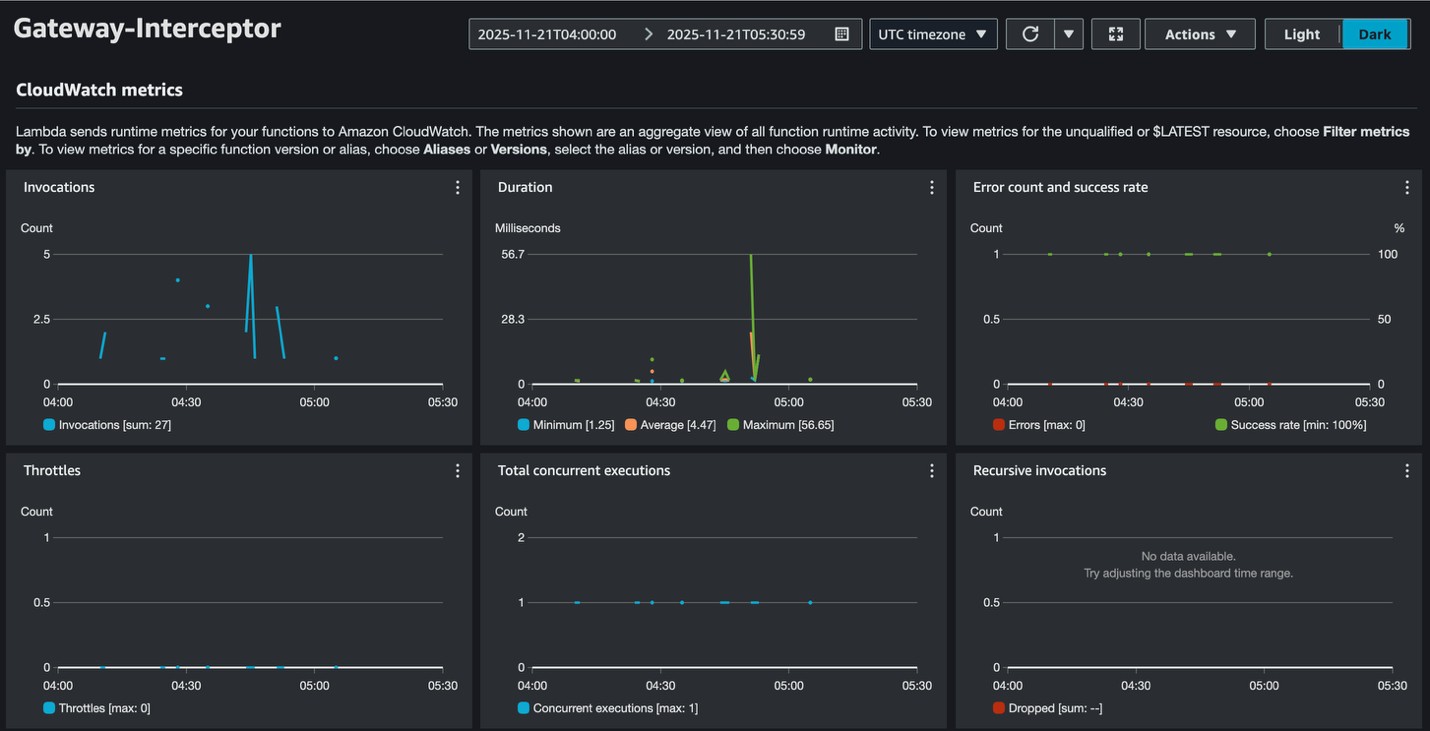

O AgentCore Runtime possui uma tradução integrada que transforma a requisição de entrada no formato JSON-RPC 2.0 do MCP e invoca as ferramentas apropriadas. O registro de eventos pode ser habilitado para registrar tudo no Amazon CloudWatch.

O servidor MCP executa a lógica das ferramentas, recupera dados do DynamoDB e S3, e invoca o Amazon Nova 2 Lite através da API Converse do Amazon Bedrock para gerar uma resposta com um processo detalhado de raciocínio. A resposta é transformada novamente para corresponder ao protocolo do Quick Suite e retornada ao usuário através da interface do assistente.

O Amazon Nova 2 Lite oferece capacidades importantes nesse cenário: consegue solicitar ferramentas e compreender seus esquemas, realiza raciocínio para determinar quais ferramentas são necessárias baseado nas perguntas do usuário, e então gera requisições de ferramentas com parâmetros validados que o servidor MCP executa.

Implementação prática da solução

Pré-requisitos

Para colocar em prática essa solução, você precisará de:

- Uma conta AWS

- Amazon Quick Suite configurado com assinatura Author Pro

- Permissão para criar funções e políticas de AWS Identity and Access Management (IAM) e recursos AWS, incluindo tabela DynamoDB, bucket S3, pool de usuários Cognito e AgentCore Runtime

- Acesso a um ambiente de linha de comando com AWS SDK e Python instalados

Hospedagem do servidor MCP

A implementação começa clonando o repositório de código correspondente. Em seguida, você edita o arquivo de configuração config/enterprise_config.yaml para fornecer o nome do servidor MCP, o pool de usuários Cognito, as tabelas DynamoDB contendo solicitantes e sinistros, e o bucket S3 para registros médicos.

Depois, configura um ambiente virtual Python com as dependências necessárias:

python -m venv smart_insurance_agent_venv

source smart_insurance_agent_venv/bin/activate

pip install -r deployment/requirements.txtOpcionalmente, você pode gerar dados sintéticos de solicitantes, registros médicos e sinistros. A geração de dados sintéticos utiliza a biblioteca faker para criar registros de solicitantes e sinistros que são persistidos no DynamoDB e registros médicos que são persistidos no S3 em formato JSON. Você pode modificar o esquema ou formatos de registro personalizando o script de carregamento conforme suas necessidades.

Com tudo preparado, você implanta o servidor MCP no Amazon Bedrock AgentCore executando o script de implantação. Este passo cria um pool de usuários Cognito, constrói uma imagem Docker, a implanta no AgentCore, configura permissões IAM, e gera a documentação com a URL do endpoint do servidor MCP e configuração OAuth necessária para integração com o Quick Suite.

Para validar que tudo funcionou corretamente, executa o teste de funcionalidade das ferramentas MCP. A execução bem-sucedida fornecerá uma saída confirmando que o servidor foi implantado e operacional.

Integração com Quick Suite

Depois, você estabelece uma conexão OAuth de serviço a serviço do Quick Suite para o endpoint hospedado no Amazon Bedrock AgentCore. Essa conexão permite que seu agente de conversa do Quick Suite invoque ações do servidor MCP para cumprir solicitações dos usuários.

No console do Quick Suite, você navega até Integrações e cria uma nova integração MCP. Na página de configuração de conexão, fornece os detalhes do servidor MCP: um nome (por exemplo, “Especialista em Análise de Seguros”), uma descrição opcional e a URL do endpoint do servidor MCP.

Na página de autenticação, você seleciona autenticação de serviço, escolhe OAuth de serviço a serviço como tipo de autenticação, e fornece o ID de cliente, segredo do cliente e URL do token. Depois de revisar e confirmar, a integração está pronta.

Para testar, você acessa a seção de Integrações no console, verifica que o status está “Disponível”, seleciona a integração criada e testa as APIs de ação para confirmar que estão funcionando corretamente.

Criando o agente de conversa personalizado

Agora você cria um agente de conversa customizado no Quick Suite. Você fornece um nome para identificar o agente e uma descrição opcional que ajude os usuários a entender seu propósito.

Na configuração do agente, você define sua identidade. Um exemplo seria: “Você é Nova, um Analista de Seguros baseado em IA com expertise profunda em avaliação de risco explicável e detecção de fraude. Você tem acesso a dados empresariais de seguros incluindo mais de 1000 perfis de solicitantes, registros médicos e histórico de sinistros através de capacidades avançadas de raciocínio”.

Você também fornece instruções de persona que definem como o agente interage com usuários durante a conversa. Por exemplo, instruções que enfatizam transparência, explicam o nível de confiança nas recomendações, decompõem decisões complexas em passos lógicos claros, referenciam perfis específicos de solicitantes quando disponível, fornecem pontuações de risco com explicações detalhadas dos fatores contribuintes, incluem considerações de conformidade regulatória, e oferecem perguntas de acompanhamento para aprofundar a análise quando apropriado.

Na seção de Ações, você vincula o conector de ação que criou, lançando o agente. Após alguns minutos, o agente estará operacional e pronto para conversar.

Você pode começar pedindo ao agente uma avaliação de risco específica — por exemplo, “Avalie o risco para o solicitante APP-0900”. O agente processará a requisição, invocará as ações necessárias, e retornará uma análise detalhada. A interface da conversa pode solicitar informações adicionais para algumas ações antes de proceder, garantindo precisão na análise.

Benefícios da abordagem

Essa arquitetura soluciona os três desafios centrais mencionados no início. Primeiro, unifica dados de DynamoDB e S3, permitindo que o sistema acesse informações completas sobre solicitantes, registros e histórico de sinistros em uma única consulta. Segundo, entrega raciocínio passo a passo transparente para cada decisão, atendendo requisitos regulatórios de explicabilidade e auditoria. Terceiro, mantém trilhas de auditoria completas no CloudWatch para conformidade regulatória, e permite que investigadores façam perguntas como “Mostre-me todos os sinistros registrados dentro de 30 dias do início da apólice” para identificar padrões suspeitos.

Com essa solução em operação, você consegue escalar análises de risco — líderes de negócios ganham inteligência de portfólio em tempo real através de interações em linguagem natural, e todo o processo de análise é rastreável e auditável do início ao fim.

Limpeza de recursos

Após experimentar a solução, você pode remover todos os recursos AWS criados para evitar cobranças contínuas usando o script fornecido na documentação de implantação.

Fonte

Create an intelligent insurance underwriter agent powered by Amazon Nova 2 Lite and Amazon Quick Suite (https://aws.amazon.com/blogs/machine-learning/create-an-intelligent-insurance-underwriter-agent-powered-by-amazon-nova-2-lite-and-amazon-quick-suite/)